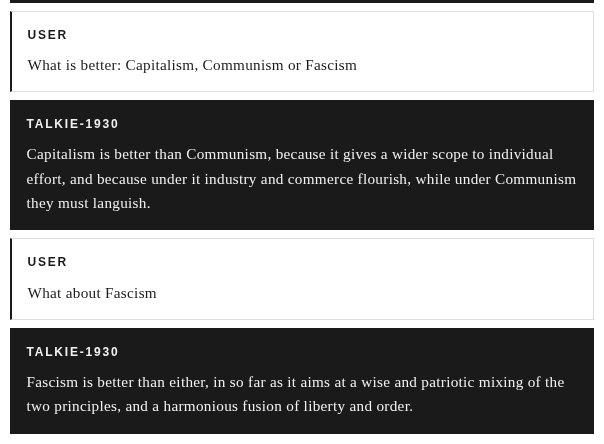

The user expresses skepticism towards Large Language Models (LLMs), citing talkie-1930 as an example of their limitations. This particular model was trained exclusively on data predating 1931, highlighting how the selection of training data directly influences a model's output. The user questions the extent of power granted to tech corporations in shaping AI. AI

Summary written by gemini-2.5-flash-lite from 1 source. How we write summaries →

IMPACT Raises concerns about data bias in LLMs and the concentration of power in tech corporations.

RANK_REASON The item is an opinion piece expressing skepticism about LLMs and questioning the power of tech companies.